Słyszymy już o tekstyliach, które zabijają wirusa, o aplikacjach, które mają nas informować, czy...

„Powinniśmy inwestować w technologie, które w centrum stawiają człowieka, użyteczność i dbałość o prywatność”

Przeczytaj

Temat interfejsów konwersacyjnych, czyli komunikowania się przy pomocy głosu z otaczającą technologią, pojawiał się na moim blogu wiele razy wraz z licznymi analizami, danymi i sygnałami zmian z różnych regionów świata. Nie da się ukryć, że jest to jeden z wiodących kierunków rozwoju technologii nad którym pracują globalni giganci. W dyskusjach pod moimi artykułami, czy też w mediach społecznych, często przewijał się jeden zarzut względem tego trendu. Wiązał się on z tym, że publicznie, wśród dużej liczby obcych osób, nie będziemy chcieli mówić do naszych urządzeń przenośnych, chcąc chronić nasze prywatne sprawy.

Argument ten należałoby uznać za słuszny, wszak nie każdy, kto stoi obok nas w tramwaju, sklepie czy na korytarzu w firmie, musi wiedzieć dokąd i po co jedziemy, składników jakiego przepisu szukamy na sklepowych półkach lub która osoba w pracy nie do końca spełnia pokładane w niej nadzieje. Nie wszystkim to jednak przeszkadza, czego dowodem niech będzie choćby liczba firmowych tajemnic, wyjawianych na głos w pociągowych wagonach (pisałem o tym często na Twitterze in real time do chwili, gdy pojawiły się wagony ciszy). Podobnie rzecz ma się z ułatwieniami, które od pewnego czasu dostępne są w naszych telefonach komórkowych. Mam na myśli dyktowanie wiadomości i treści maili, nagrywanie długich notatek głosowych w komunikatorach internetowych i korzystanie z asystentów głosowych, takich jak Apple Siri czy Google Assistant. Korzystamy z nich coraz częściej, bo ułatwiają nam codzienne życie i pracę, lecz przede wszystkim, przyspieszają przesyłanie dużej ilości informacji bez konieczności pisania na naszych urządzeniach.

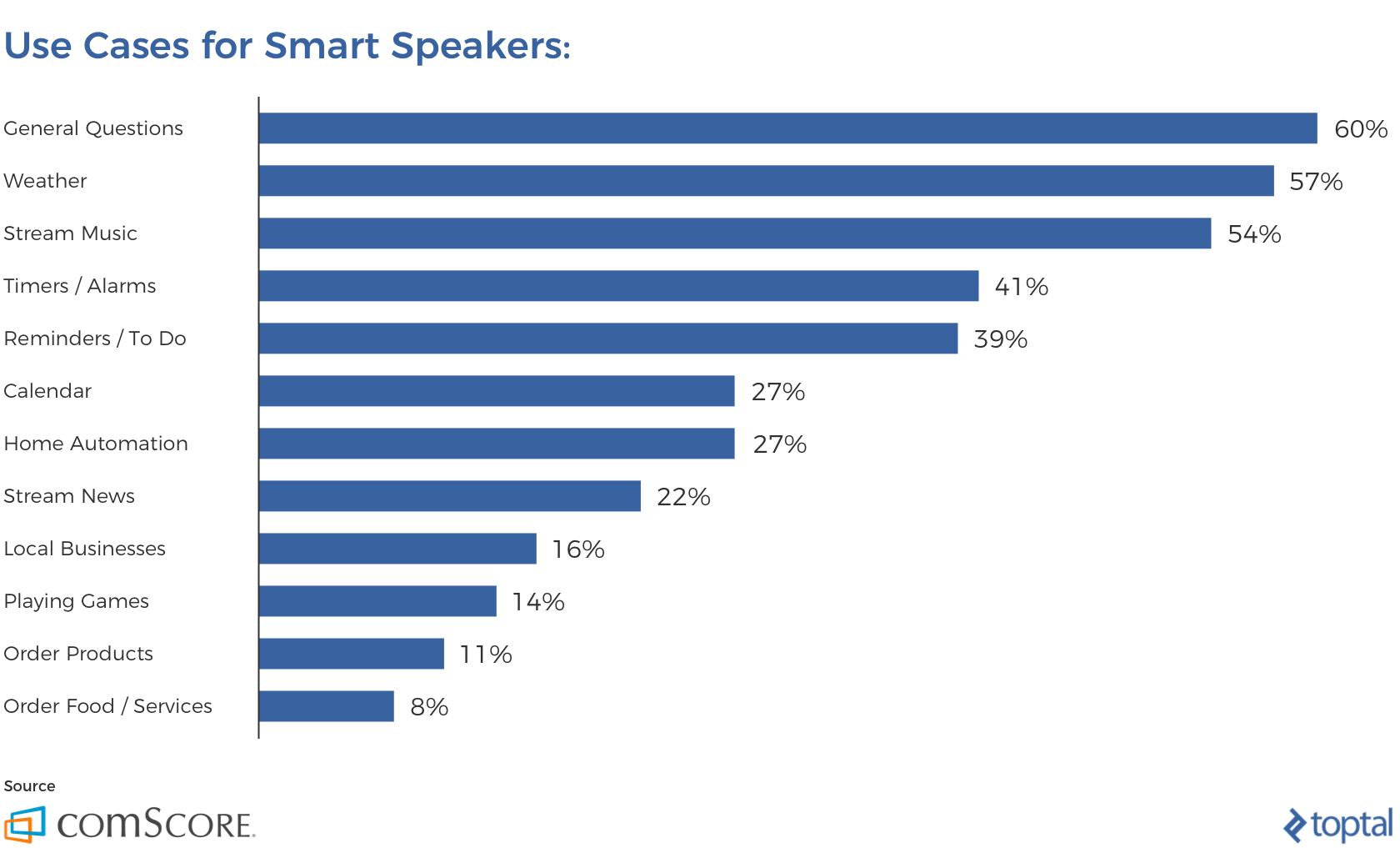

Najczęstsze wykorzystanie asystentów głosowych [comScore]

Publiczne dyktowanie lub odpytywanie asystentów głosowych w naszym codziennym otoczeniu może jeszcze czasami dziwić. Inaczej wygląda to, gdy opuścimy granice Europy i wybierzemy się na przykład do Dubaju, w którym jest to już zupełnie naturalne zachowanie, udanie zastępujące proces wpisywania poprzez ekrany dotykowe. Będąc w tym mieście podczas targów GITEX i przemykając po ulicach w poszukiwaniu cienia lub stacji metro, byłem pod dużym wrażeniem, jak wiele osób w miejscach publicznych korzysta z możliwości głosowego wprowadzania informacji, zarówno zawodowych, jak i zupełnie prywatnych (rozróżnienia dokonywałem wyłącznie u osób posługujących się językiem angielskim). Nie widziałem jakiegokolwiek skrępowania wspomaganiem się asystentami głosowymi, ani też dyktowanym sposobem komunikacji, widać było natomiast przyzwyczajenie do tej formy wykorzystania technologii. Byłem w wielu miejscach na świecie, ale nigdzie dotąd nie dostrzegłem tak wyraźnej adaptacji interfejsów głosowych.

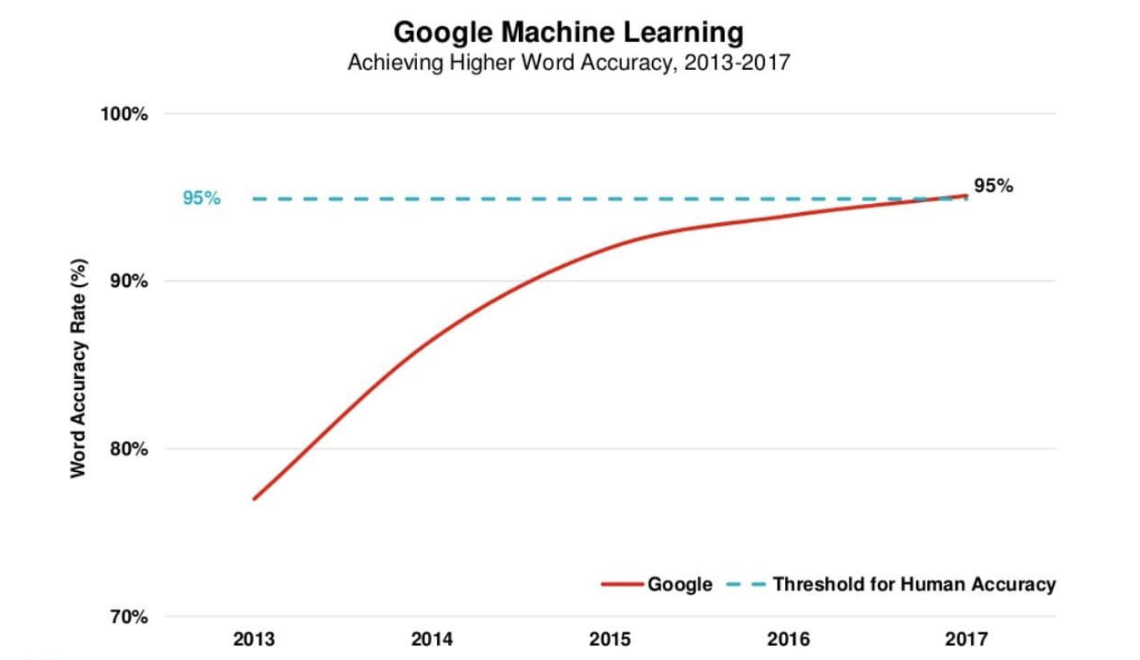

Mówi się, że silne trendy nie tolerują granic. Zachowanie, które dziś jest naturalne, np. w kraju na Bliskim Wschodzie, niebawem może stać się czymś oczywistym w kulturze i zachowaniach ludzi z bliższego nam regionu. W przypadku intuicyjnego korzystania z asystentów głosowych największą barierę (choćby w Polsce,) stanowi oczywiście brak rodzimego języka, a nie każdy potrafi i chce mówić do otaczającej go technologii po angielsku. To jednak może się zmienić w niedalekiej przyszłości (Google Assistant już rozpoznaje bardzo wiele polskich zapytań), bowiem trend Voice Interfaces wchodzi w swój okres dojrzałości, a wraz z nim dostępne stają się kolejne języki, obsługiwane przez telefony czy smart asystentów. Inne z kluczowych wymagań rozwoju technologii głosowych, tj. stopień zrozumienia przez urządzenia języka mówionego (tzw. NLP), jest również bliskie spełnienia. W tym roku Word Error Rate technologii rozwijanych przez Google spadł do „magicznych” 4,9 procent, co oznacza, że poziom komunikacji maszyna-człowiek, zbliżył się do poziomu normalnej komunikacji między ludźmi.

Wzrost skuteczności rozpoznawania ludzkiej mowy [Google]

Przyswajanie technologii głosowych jest szczególnie szybkie wśród młodych osób z tzw. Generacji Z i sięga nawet 71% w USA. W Europie, według danych Global Web Index, wskaźnik ten wynosi 25% (taki odsetek osób odpowiedziało twierdząco na pytanie: czy korzystałeś/korzystałaś z technologii głosowych w ostatnim tygodniu). Z kolei aż 72% osób, które posiadają urządzenie sterowane głosem deklaruje, że korzysta z niego codziennie.

Co to wszystko oznacza dla marek, chcących odpowiednio wcześnie reagować na zachodzące zmiany? Konieczność zaniechania dywagacji w stylu „czy ludzie będą wstydzili się mówić na głos do swoich urządzeń przenośnych w miejscach publicznych?”. Będą. Tak jak robią to w Dubaju (i pewnie wielu innych krajach, w których wygodę przedkłada się nad prywatność), tak też za jakiś czas częściej będą czynić to w naszym najbliższym otoczeniu. To kwestia wyeliminowania przeszkód, o których wspomniałem powyżej, które blokują jeszcze pełne wykorzystanie technologii głosowych. To jednak przede wszystkim odpowiednia chwila, aby zadać wewnątrz przedsiębiorstwa pytanie: jaką moja marka posiada strategię w odniesieniu do szybkiego rozwoju urządzeń takich jak Google Home, Amazon Alexa, a także Apple Siri czy Google Assistant. Z odpowiedzią i podjęciem działań nie warto czekać, szczególnie, jeśli w 2020 roku aż 30% wszystkich wyszukiwań w internecie ma być dokonywanych z pominięciem ekranu.

Pozostałe artykuły, które opublikowałem w ramach 1 i 2 sezonu projektu #techhumanized można znaleźć tutaj.

#techhumanized powered by T-Mobile – projekt długofalowej kooperacji między twórcą i marką, której celem jest obserwacja zmieniającego się świata technologii, przybliżanie innowacji i kierunku ich rozwoju, a także wyjaśnianie, jak te zmiany wpłyną na nasze życie. Jak zmienią je za kilka, kilkanaście lub kilkadziesiąt lat. Mecenasem projektu nieustannie od dwóch sezonów pozostaje marka T-Mobile Polska.